인공지능(AI) 시대를 마주한 언론계 속내는 복잡하다. 데이터 분석 등 AI로 양질의 기사를 쓸 수도 있지만 활용에 뒤처져 다른 미디어에 영향력을 빼앗길 수도 있다. 챗GPT의 등장으로 ‘변곡점’이 생긴 상황. 언론은 AI에 어떻게 접근해야 할까.

9일 서울 중구 프레스센터에서 한국언론진흥재단 주최로 2023 KPF 저널리즘 컨퍼런스 ‘AI와 언론의 혁신’이 열렸다. 연사로 나선 찰리 베켓 런던정치경제대학교 미디어커뮤니케이션학과 교수는 발표에서 “AI로 더 깊이 인간을 탐구하는 언론의 역할을 기대할 수 있다”면서도 “비즈니스 모델 자체가 위협에 놓여 언론이 사람들에게 잊힐 수도 있다”고 우려했다.

베켓 교수가 현장에서 챗GPT를 사용한 적이 있냐고 묻자 대부분의 사람들이 손을 들었다. 베켓 교수는 “챗GPT는 사용하기 굉장히 쉬운데 결과가 흥미롭다”며 “이전의 AI는 기술 지식이 필요했다. 하지만 이건 누구나 사용할 수 있다. 언론사 입장에선 ‘게임체인저’”라고 말했다.

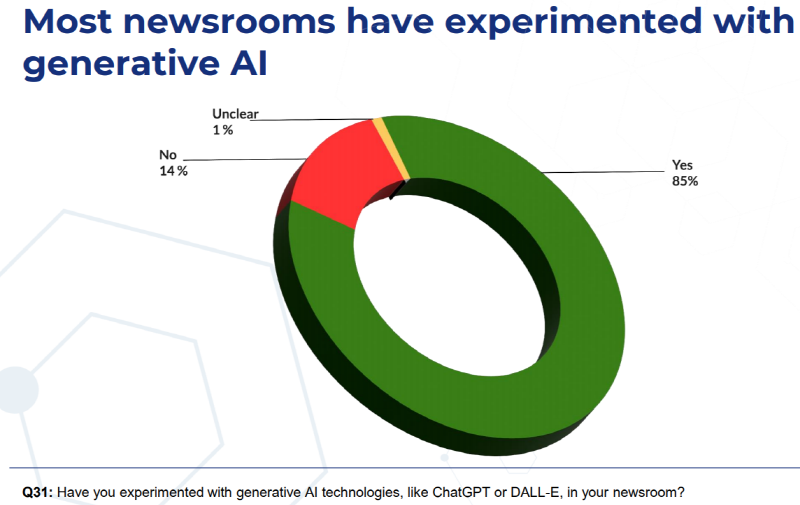

2019년 미디어 싱크탱크 폴리스(Polis) 설문조사 결과, 뉴스룸 85%가 생성형 AI를 업무에 활용한 경험이 있다고 답했다. 베켓 교수는 “선거가 다가오니 팩트체크, 허위정보를 확인하는 데 AI를 사용할 수 있다. 언론사 콘텐츠의 개인화, 자동화뿐 아니라 텍스트 자체의 요약과 형식 자체를 바꾸는 혁신에도 활용할 수 있을 것”이라며 “특히 AI 챗봇이 있다면 기본적인 인터뷰를 맡길 수 있다”고 말했다.

베켓 교수는 “낙관론적 사고를 펼쳐보자면 AI로 효율성이 높아져 전문기사든 탐사보도든 인간의 관심사 끌어내는 언론의 역할을 할 수 있다. AI가 놓치는 도덕, 감정, 흥분, 유머 등 인간만이 가지고 있는 특성을 극대화하는 것”이라며 “인간 언론인들은 판단을 하고 있다. AI는 그런 능력이 없다. 개인적으로 AI를 잘 활용하면 ‘인간’ 언론이 할 수 있는 걸 더 잘할 수 있게 될 것이다. 기자들의 시간을 절약해주기 때문”이라고 말했다.

장밋빛 전망만 있는 건 아니다. △모든 분야에 적용되는 리스크(인종 등 각종 차별, 허위정보, 저작권, 규제) △미디어에 적용되는 리스크(기술 종속, 연결 해체 경쟁) △저널리즘에 대한 리스크(부정확성, 품질 위협, 비즈니스 모델 위협, 뒤처질 위험) 등이 꼽혔다. 베켓 교수는 “생성형 AI가 답을 하지 못하는 영역들이 있다. 개발자들은 한계를 알고 있을 것”이라며 “받은 데이터가 서양 중심, 영어 중심이라는 것도 잊어선 안 된다”고 말했다.

이어 “기술 의존성이 커지면 문제가 된다. 언론이 기술을 감당할 만한 재정, 시간 등 자원을 투입할 여력이 있는지도 문제”라며 “AI는 진실을 보장하지 않는다. 그런 상황에서 언론사의 가치를 준수할 수 있는지가 관건이다. 간단한 클릭으로 정보를 얻어내는 시대에 언론의 가치를 못 느낄 수도 있다. 정보를 얻기 위해 언론에게 올 필요가 없지 않나. 챗GPT는 기사 링크을 걸어주지 않는다. 비즈니스 모델 자체가 위협에 놓여 언론이 잊히고 후퇴할 수 있다”고 말했다.

어떻게 해야 언론이 AI를 잘 활용할 수 있을까. 베켓 교수는 △정보 유지하기(Get informed) △AI 리터러시 확대(Broaden AI literacy) △책임 할당(Assign responsibility) △테스트 반복(Test, iterate, repeat) △가이드라인 작성(Draw up guidelines) △공동 작업 및 네트워크(Collaborate and network) 등을 AI를 위한 언론의 ‘필요 전략’으로 꼽았다.

관련기사

베켓 교수는 “공부를 계속 하라. 모든 언론사 직원들이 어느 정도는 생성형 AI를 알아야 한다. AI는 앞으로도 계속 영향을 미칠 것”이라며 “AI 기술 활용에 대한 책임도 나눠야 한다. 이게 무엇인지 고민할 수 있는 전담 직원을 반드시 지정하라. 조직 자체에서 이에 대한 이야기가 진행되고 부서 간 조율할 수 있게끔 해야 한다”고 말했다.

아울러 “가이드라인이 마련될 때 기자들이 안심한다. 가이드라인을 작성했다는 것만으로도 과정에서 많이 배울 것”이라며 “언론은 R&D를 많이 하지 않는다. 산업이든 학계든 협력을 통해 가진 자원을 극대화할 필요가 있다”고 강조했다.