사람이 아닌 인공지능이 방송을 편집하기 시작했다.

SBS가 국내 최초로 인공지능으로 클립영상을 편집해 방송에 내보내는 서비스를 선보이고 있다. 지난 19일 서울 목동 SBS사옥에서 만난 SBS 미디어기술연구소 박재현 차장과 홍순기 박사는 “현재의 인공지능 기술 접목은 초기 단계”라며 장기적으로 본방송 편집에도 인공지능이 역할을 할 수 있을 것으로 전망했다.

인공지능 편집 클립 영상은 현재 UHD 서비스 화면에서 찾아볼 수 있다. UHD 방송은 인터넷을 연결하면 IPTV를 보는 것처럼 편성 스케줄, 작품 설명, 클립 영상 시청이 가능하다. 타 방송사는 포털 등에 내보낸 예능·드라마의 클립영상만 이 서비스에 내보내는 데 반해 SBS는 인공지능이 만든 전 장르의 클립영상을 내보내고 있다.

홍순기 박사는 “온라인 공간에서 영상 소비가 주목 받으면서 동영상 축약이 중요해졌다”고 설명했다. 그에 따르면 축약 영상은 ‘클립형’과 ‘요약형’으로 나눌 수 있다. ‘클립형’은 하이라이트를 발췌해 3~5분 단위로 편집한 영상이고, ‘요약형’은 ‘드라마 5분 만에 보기’와 같은 가공 영상을 말한다. 홍 박사는 “요약형은 스토리 라인을 인공지능이 다 인식해야 하는데, 현재 기술로는 힘들다. 반면 클립형은 도입이 가능한 수준”이라고 말했다.

영상 편집은 SBS 미디어기술연구소 인공지능 클립 생성 시스템인 ACES(Artificial intelligence Clip Export System)를 기반으로 한다. 시스템을 켜고 ‘목표시간’(러닝타임)을 입력하면 자동으로 영상을 분석해 클립 영상들을 만든다. 현재 1시간 분량의 프로그램 편집에 15분가량 걸린다.

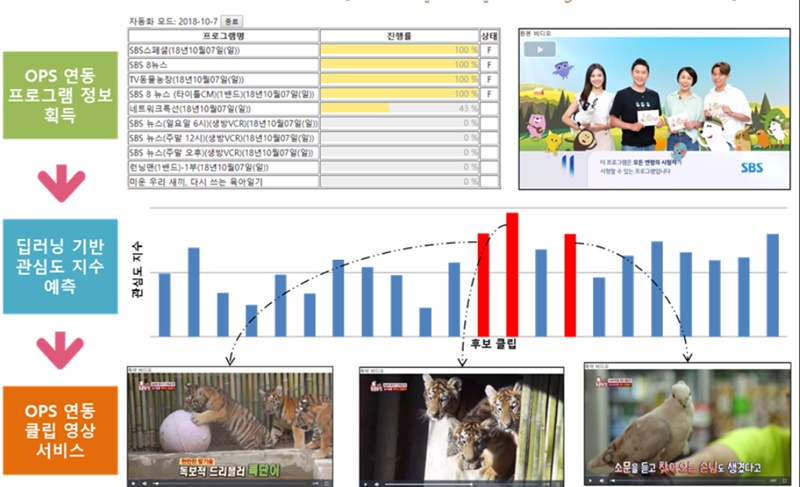

클립 영상 제작 원리는 ACES와 OPS(온라인 퍼블리싱 시스템)의 연동으로 이뤄진다. OPS는 방송에 나오는 인물, 장소 등 메타데이터를 입력하고 장면(Scene) 단위로 방송 콘텐츠를 분류, 관리하는 SBS 내부 시스템을 말한다.

예를 들어 ‘동물농장’ 본방송이 끝나면 방송이 장면단위로 OPS에 입고된다. 이 데이터를 ACES에서 가져와 인공지능이 ‘영상 내 분석’ ‘영상 간 분석’ 등으로 각 장면의 중요도를 판단한다. ‘동물농장’의 경우 동물을 만나러 이동하는 장면은 중요도가 낮아 낮은 점수를 주고, 주요 오브젝트인 동물이 나오는 장면, 특히 동물이 크게 나오는 장면에 높은 점수를 주는 식으로 중요도를 판단해 편집한다. 분석이 완료된 영상은 OPS에 다시 보내 온라인 유통이 가능한 형식으로 변환한다. 작업이 끝나면 사람의 평가와 인공지능 딥러닝 품질평가 등을 통해 개선을 반복한다.

박재현 차장은 “SBS는 방송의 정보를 온라인에 맞게 가공할 수 있는 OPS를 구축했다”며 “이를 기반으로 학습 데이터를 많이 갖고 있다. 다른 방송사에서는 이런 시스템이 갖춰지지 않아 도입하기 힘들 것”이라고 설명했다.

사람이 해도 되는 일인데 굳이 인공지능이 클립 영상을 만들어야 할까. 홍 박사는 “사람의 직접 편집은 인건비가 들고 장비가 필요하고 시간이 든다. 그래서 광고를 붙일 수 있는 예능·드라마가 아닌 시사와 교양 프로그램에는 적용하기 힘들다”고 지적했다. 방송사 연합으로 만들어 클립 영상을 서비스하는 업체인 SMR이 드라마·예능 등 일부 인기 장르에만 한정해 클립 영상을 포털에 올리는 것도 이 때문이다. 하지만 ‘돈 안 되는’ 시사교양도 인공지능이 있으면 클립 영상을 쉽게 만들 수 있다.

중요도 중심으로 편집하는 현재 방식을 도입하는 데까지는 여러 시행착오가 있었다. 홍 박사는 “처음에는 ‘개체 인식’ ‘인물 인식’ 등의 방식으로 연구했는데 시행착오가 있었다”고 설명했다. ‘인물 인식’의 경우 사람을 찾는 데는 유용했지만 중요한 내용, 또는 재미있는 내용을 찾을 수는 없었다. 또, 인물을 인식하려면 반복출연이 돼야 하는데 방송 프로그램의 중심은 고정 출연자가 아닌 게스트이기 때문에 인식에 한계가 있었다.

박재현 차장은 현재의 클립 영상 편집은 시작 단계라고 설명했다. “(인공지능은) 제작에도 도입할 수 있다고 본다. 현재 예능 장르의 경우 1시간 내보내기 위해 100시간씩 찍는다. 이 가운데 불필요한 방송분을 걸러내는 1차 편집에 비용이 많이 드는데, 이를 인공지능이 대신할 수 있다. 다만, 실무자의 신뢰를 받아야하기 때문에 당장 대체하기에는 한계가 있다. UHD서비스를 통해 딥러닝 네트워크를 확대하고 신뢰성을 높인 실무진에게 검증을 받을 계획이다.” 미래에는 24시간 편집실에 갇혀있던 조연출이 사라질지 모른다.