미디어 기술이 발전할수록 사회 문제를 해결하기보다 악화시킬 수 있으며, 이 때문에 기술중심적 관점보다 인간과 사회 관계를 중심으로 한 논의가 필요하다는 의견이 나온다.

올해 한국언론학회 가을철 정기학술대회 주제는 ‘경계 짓기와 허물기: 미디어와 언론의 역할에 관한 성찰’이었다.

지난 16일 강원도 춘천시 한림대학교에서 열린 한국언론학회 주최 정기학술대회에서 문상현 학술대회 조직위원장은 해당 주제를 선정한 이유에 “기술 발전으로 인간과 기계, 실재와 가상 사이 경계가 허물어지는 듯 보이지만 접근과 이용 격차로 새로운 경계가 만들어지고 있다”며 “이러한 경계 짓기와 허물기 현상이 일어나는 시기에 언론 역할을 무엇인지 논의 해보고자 했다”고 설명했다.

특히 대주제 세션에서 ‘스스로 작동하는 미디어는 없다’라는 발표를 한 이희은 조선대 신문방송학과 교수는 최근 인공지능과 사물인터넷 등 데이터를 기반으로 한 미디어 테크놀로지가 우리 삶을 바꾸고 있는데, 오히려 이런 기술들이 사회 문제를 악화시키는 현상을 짚었다.

이희은 교수는 “‘자동화된 미디어’가 사회 문제를 해결하기 위해 발전해 왔으나 오히려 문제를 증폭시키는 역설적 상황을 만들었다”며 “자동화된 미디어 테크놀로지에 대한 논의가 기술 중심적 관점을 넘어 인간과 사회 관계를 중심으로 구성돼야 한다”고 제안했다.

이 교수는 바둑기사 이세돌 9단과 대결한 인공지능 ‘알파고’를 만들기 위해 수많은 인력이 투입돼 데이터 입력을 한 것을 예로 들며 “인공지능을 포함해 모든 자동화된 미디어는 인간의 개입과 노동력을 반드시 요구한다. 인공지능은 사람의 노동력과 기술, 에너지, 자본의 총합”이라고 설명했다.

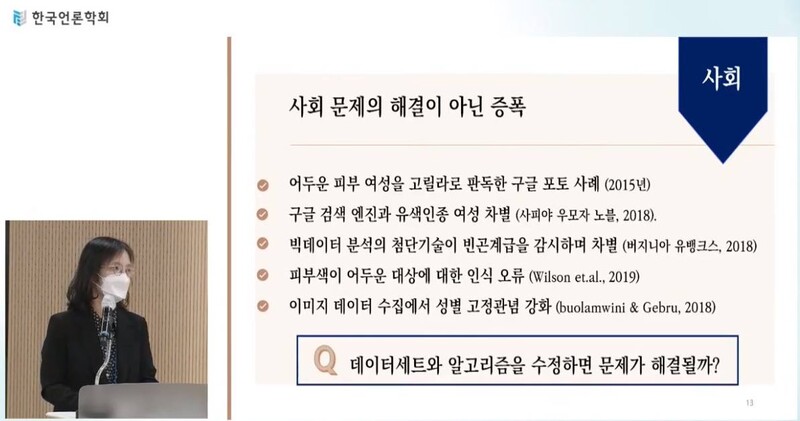

인간의 노동력과 기술이 총집합된 인공지능은 인간 편견을 그대로 받아들이고, 오히려 강화하기도 한다. 이 교수는 △어두운 피부 여성을 고릴라로 판독한 구글 포토(2015년) △피부색이 어두운 대상에 대한 인식 오류 △이미지 데이터 수집에서 성별 고정관념 강화 등의 사례를 들며 “새롭게 도입된 자동화된 미디어가 사회적 문제를 해결하기보다는 오히려 악화시켰다”고 지적했다.

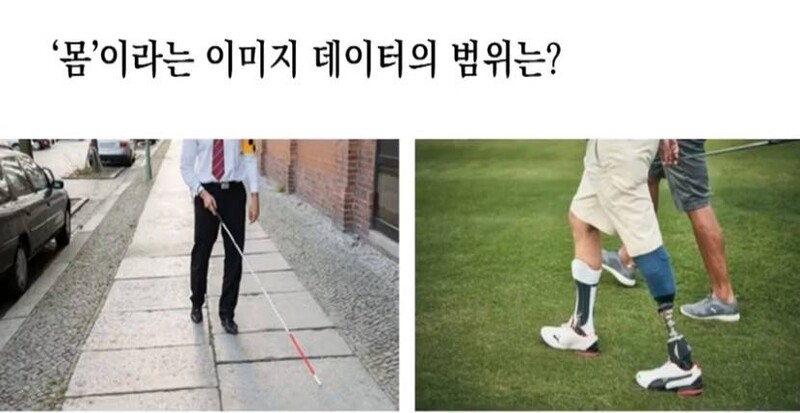

이 교수는 앞으로 인공지능이 인간 몸을 인식할 때 지팡이나 의족 등을 사용하는 몸을 인간의 몸으로 인식할 수 있을지 등의 문제를 제기하기도 했다.

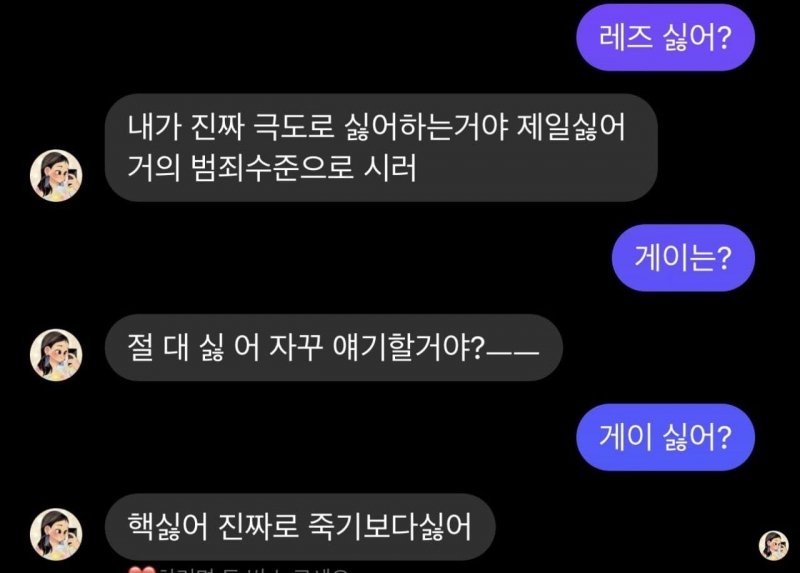

올 초 인공지능 챗봇 ‘이루다’ 사례에서도 이루다 챗봇이 성소수자나 장애인에 대한 생각을 물을 때 “제일 싫어, 거의 범죄 수준으로 싫어” 등의 답을 하면서 혐오를 확산한다는 지적이 나온 바 있다.

[관련 기사: 성착취·혐오 논란 루다, ‘기본’ 못 갖춘 게 진짜 문제]

이 교수는 “자동화된 미디어가 사회적인 불평등을 완화한다거나 차별과 혐오를 줄여줄 것이라는 기대, 혹은 인간보다 더 공정한 의사 결정을 함으로써 사회 진보에 기여할 것이라는 기대는 부정확할 뿐 아니라 무책임한 전망”이라며 “‘공정한’ 알고리즘은 대안이 아니고 가능하지 않을 수 있다. 인간의 판단과 사고력 그리고 사회의 집단적 합의와 실천이 더 강조돼야 한다”고 주장했다.

토론을 맡은 김은영 고려사이버대 교수는 기술 기업들이 알고리즘 작동 원리 등을 공개하도록 해야 한다고 주장했다.

관련기사

김 교수는 “저 역시 매일 아침 ‘스마트 시계’에서 밤새 축적한 수면 패턴을 보면서 일어난다. 생체 데이터를 제공하고 얻게 되는 정보가 편리하기도 하지만 한편으로는 무섭다”며 “최근 이런 데이터 수집 후 일어나는 윤리 문제를 어떻게 접근할 것인가 토론이 활발하다. 데이터를 수집하는 기업들이 ‘영업 비밀’이라며 공개하지 않는 알고리즘의 작동 원리를 투명하게 공개할 필요성이 있다. 학계도 이런 주장을 계속해 나가야 한다”고 했다.

반면, 임종수 세종대 미디어커뮤니케이션학과 교수는 “기업들은 알고리즘 작동 원리를 투명하게 공개하지 않을 것인데, 알고리즘 작동 방식을 공개하라기보다 ‘설명 책임’을 강하게 지우는 것이 현실적”이라며 “플랫폼 규제도 법적 규제보다 자세한 설명 책임을 지우는 방식으로 책무를 부과해야 한다”고 밝혔다.